Suchmaschineneintrag bei Google & Co.: so geht‘s

- 69 mal angesehen

Suchmaschineneintrag: Erste Schritte, um online bei Google & Co. gefunden zu werden

Du hast einen neuen Internetauftritt erstellt und fragst dich jetzt, ob du deine Website in Suchmaschinen manuell eintragen musst? Die kurze Antwort: Nein, das ist heute nicht mehr nötig. Trotzdem hält sich dieser Mythos hartnäckig. Warum das so ist und welche Schritte wirklich wichtig sind, damit deine Website gefunden wird, erfährst du in diesem Guide.

Warum hält sich der Mythos vom manuellen Suchmaschineneintrag so hartnäckig?

Früher war die manuelle Suchmaschinenanmeldung tatsächlich Pflicht, heute übernehmen Crawler diese Aufgabe automatisch. Dennoch gibt es einige technische Grundlagen, die du beachten solltest, damit Suchmaschinen wie Google, Bing und DuckDuckGo deine Inhalte schnell und vollständig indexieren. In diesem Artikel zeigen wir dir, wie die moderne Indexierung funktioniert, welche Tools du nutzen kannst und wie du den Status deiner Website überprüfst.

Früher: Manuelle Suchmaschinenanmeldung war Pflicht

In den Anfangsjahren des Internets, etwa bis Anfang der 2000er Jahre, mussten Website-Betreiber ihre Seiten tatsächlich manuell bei Suchmaschinen anmelden. Die Crawler-Technologie war noch nicht ausgereift genug, um das gesamte Web eigenständig zu durchsuchen. Wer seine Website nicht aktiv bei Yahoo, AltaVista oder frühen Google-Versionen einreichte, blieb bei der Suche unsichtbar. Der Eintrag in Suchmaschinen war damals ein bewusster, manueller Prozess. Viele Anbieter boten extra kostenpflichtige Dienste an, um Websites in hunderten Verzeichnissen und Suchmaschinen einzutragen: ein Geschäftsmodell, das heute weitgehend überholt ist.

Heute: Automatische Indexierung durch Crawler

Mittlerweile musst du deine Website nicht mehr bei Bing oder anderen Suchmaschinen eintragen lassen. Hochentwickelte Crawler (auch „Bots“ oder „Spider“ genannt) durchsuchen das Internet kontinuierlich und übernehmen das für dich. Diese Crawler folgen Links von bereits bekannten Seiten zu neuen Seiten und nehmen sie automatisch in den Suchindex auf), sodass sie auch ranken können. Du musst also weder eine Website noch eine URL manuell anmelden. Die Suchmaschineneintragung erfolgt automatisch, sofern die Website technisch zugänglich ist.

Warum hält sich der Mythos trotzdem? Viele Website-Betreibende sind unsicher, ob ihre Seite wirklich gefunden wird, und suchen nach Bestätigung. Zudem gibt es nach wie vor Anbieter, die mit der Anmeldung bei Suchmaschinen werben und so den Eindruck erwecken, dies sei notwendig. Tatsächlich kannst du den Prozess aber durch technische Maßnahmen beschleunigen und optimieren.

Die ersten Schritte zur Indexierung einer neuen Website

Bevor deine Website in den Suchergebnissen erscheint, durchläuft sie mehrere Phasen: Crawling, Indexierung, Rendering und Ranking. Beim Crawling besucht der Suchmaschinen-Bot deine Seite und liest den Inhalt aus. Anschließend nimmt die Suchmaschine die Seite in ihre Datenbank auf und indexiert sie damit. Beim Rendering verarbeitet die Suchmaschine JavaScript-Inhalte. Anschließend bestimmt das Ranking, an welcher Position deine Seite in den Suchergebnissen erscheint.

Damit dieser Prozess reibungslos funktioniert, musst du sicherstellen, dass deine Website für Crawler zugänglich ist. Das bedeutet: keine technischen Blockaden, eine klare Struktur und relevante Inhalte. Die wichtigsten technischen Grundlagen dafür schauen wir uns jetzt an.

Sitemap erstellen und zugänglich machen

Eine Sitemap ist eine XML-Datei, die alle aus SEO-Sicht wichtigen URLs deiner Website auflistet. Sie hilft Suchmaschinen, deine Inhalte schneller und vollständiger zu erfassen. Zudem kannst du damit das Crawling aktiv steuern. Besonders bei großen Websites oder einem Website-Relaunch ist eine Sitemap unverzichtbar. Die Sitemap sollte eine eigene URL haben und im Root-Verzeichnis abgelegt werden, zum Beispiel: https://www.deine-website.de/sitemap.xml.

Du kannst eine Sitemap manuell erstellen oder automatisch über dein Content-Management-System (CMS) generieren lassen. Anschließend reichst du die Sitemap über die Google Search Console oder die Bing Webmaster Tools ein. Zwar ist das keine Garantie dafür, dass der Bot alle relevanten Seiten crawlt und indexiert, aber du erleichterst ihm die Arbeit erheblich. Das wirkt sich meist positiv aus. Wenn du deine Website kostenlos in Suchmaschinen eintragen möchtest, ist die Sitemap-Einreichung der effektivste Weg.

robots.txt richtig konfigurieren

Die robots.txt-Datei ist eine Textdatei im Stammverzeichnis deiner Website (z. B. www.deine-website.de/robots.txt), die Suchmaschinen-Crawlern mitteilt, welche Bereiche deiner Website sie durchsuchen dürfen und welche nicht. Mit der robots.txt kannst du sowohl einzelne URLs als auch ganze Verzeichnisse oder Dateitypen vom Crawling ausschließen.

Wichtig: Eine falsch konfigurierte robots.txt kann dazu führen, dass wichtige Seiten nicht indexiert werden können. Deshalb solltest du nur nach Rücksprache mit einem Experten einzelne URLs vom Crawling ausschließen. Zudem kannst du hier auch den Link zu deiner Sitemap angeben, um Crawlern die Arbeit zu erleichtern.

| Begriff | Definition | Bedeutung für KMU |

| Indexing | Aufnahme der Website in die Datenbank der Suchmaschine | Voraussetzung, um überhaupt in Suchergebnissen zu erscheinen |

| Rendering | Verarbeitung von JavaScript und dynamischen Inhalten | Wichtig für moderne Websites mit interaktiven Elementen |

| Ranking | Positionierung in den Suchergebnissen basierend auf Relevanz | Entscheidet über Sichtbarkeit und Traffic |

Technische Grundlagen für erfolgreiche Indexierung

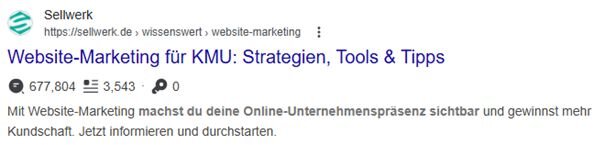

Meta Tags optimal einsetzen

Meta Tags sind HTML-Elemente, die Suchmaschinen wichtige Informationen über deine Seite liefern. Der wichtigste Meta Tag ist der Title Tag (Seitentitel), der in den Suchergebnissen (SERPs) als Überschrift angezeigt wird. Die Meta Description liefert eine kurze Zusammenfassung des Seiteninhalts und beeinflusst die Klickrate. Prüfe vorab mit kostenlosen Tools die Länge der Meta-Daten, damit sie nicht in den SERPs abgeschnitten erscheinen. Hier ein Beispiel für überzeugende Meta-Daten:

Jede Seite sollte einen einzigartigen Title Tag und eine aussagekräftige Meta Description haben. Vermeide Duplicate Content und recherchiere relevante Keywords, die du in die Meta-Daten einbauen kannst. Ein weiterer wichtiger Meta Tag ist der „noindex“-Tag, mit dem du Seiten von der Indexierung ausschließen kannst, etwa Danke-Seiten oder interne Suchseiten.

Status-Codes verstehen (200, 404, 301, 302)

HTTP-Status-Codes teilen Suchmaschinen mit, ob eine Seite erfolgreich geladen wurde. Der wichtigste Code ist 200 (OK). Er signalisiert, dass die Seite erreichbar ist. Ein 404-Fehler hingegen bedeutet, dass die Suchmaschine die Seite nicht finden konnte, was sich negativ auf die Nutzererfahrung und das Ranking auswirken kann.

301-Weiterleitungen (permanente Weiterleitungen) sind wichtig, wenn du URLs änderst oder Seiten zusammenführst. Sie leiten Nutzende und Crawler automatisch zur neuen URL weiter und übertragen die Ranking-Signale größtenteils. Der Status-Code 302 sollte nur verwendet werden, wenn die Weiterleitung vorübergehend ist.

Canonical Tags richtig verwenden

Canonical Tags zeigen Suchmaschinen, welche Version einer Seite als „Hauptversion“ indexiert werden soll. Das ist wichtig, wenn mehrere ähnliche oder identische Seiten existieren. Google weiß bei doppelten Inhalten (Duplicate Content) sonst nicht, welche Seite ranken soll und positioniert im Zweifel keine davon gut. Typische Situationen, in denen du den Canonical Tag brauchst, sind zum Beispiel Produktvarianten, gefilterte Seiten mit URL-Parametern (z. B. „?utm_source=newsletter“ oder „?color=blau“) oder Artikel, die in mehreren Kategorien auftauchen. Das betrifft oft Online-Shops.

Ein Canonical Tag sieht so aus: <link rel="canonical" href="https://www.deine-website.de/hauptseite"/>. Er wird im HTML-Headerbereich der Seite eingefügt. Achte darauf, dass jede Seite entweder einen Self-Canonical (verweist auf sich selbst) oder einen Canonical auf die Hauptversion hat.

Wichtig: Die als Original angegebene URL sollte immer die am besten optimierte Seite sein und darf auf keinen Fall gleichzeitig mit „noindex" ausgezeichnet sein, da sich diese beiden Signale widersprechen.

Interne und externe Verlinkung

Interne Links helfen Crawlern, alle Seiten deiner Website zu finden und zu indexieren. Eine klare, logische Linkstruktur ist essenziell. Achte darauf, dass wichtige Seiten von der Startseite aus mit maximal drei Klicks erreichbar sind. Crawler folgen Links: Je besser deine Seiten verlinkt sind, desto schneller werden sie gefunden.

Auch Backlinks, also externe Links, die von anderen Websites auf deine Seite verweisen, sind ein zentraler Rankingfaktor im SEO und somit Teil jeder Website-Optimierung. Die Logik dahinter: Wer viele Verlinkungen erhält, muss relevante Inhalte bieten. Allerdings zählt schon lange nicht mehr die bloße Anzahl der Links, sondern vor allem ihre Qualität. Ein einzelner Backlink von einer renommierten, thematisch passenden Website kann deutlich mehr bewirken als zahlreiche Links von unbekannten Seiten.

Content-Qualität und Ladegeschwindigkeit

Suchmaschinen bevorzugen Websites mit hochwertigem, relevantem Content. Achte darauf, dass deine Inhalte einen Mehrwert bieten, gut strukturiert und auf die Suchintention deiner Zielgruppe abgestimmt sind. Vermeide Duplicate Content (also doppelte Inhalte), da er die Indexierung negativ beeinflussen kann.

Die Ladegeschwindigkeit ist ebenfalls ein wichtiger Ranking-Faktor. Crawler besuchen langsame Websites seltener und Nutzende verlassen sie schneller. Optimiere Bilder, nutze Caching (Zwischenspeicherung zur Verbesserung der Ladegeschwindigkeit) und reduziere unnötige Skripte, um die Performance zu verbessern. Tools wie Google PageSpeed Insights helfen dir, Schwachstellen zu identifizieren.

Status Quo der Indexierung überprüfen und überwachen

Am besten nutzt du dafür die Webmaster-Tools der jeweiligen Suchmaschine. Wie das bei Bing funktioniert, erfährst du im nächsten Abschnitt. Wenn du wissen möchtest, wie du den Status deiner Website über die Google Search Console überprüfen kannst, wirf einen Blick in den Artikel über Google Indexierung.

Indexierung prüfen mit den Bing Webmaster Tools

Ähnlich wie die Google Search Console bieten die Bing Webmaster Tools umfassende Funktionen zur Überwachung deiner Website. Du kannst hier ebenfalls Sitemaps einreichen, Crawling-Fehler identifizieren und Performance-Daten einsehen. Wenn du deine Website bei Bing eintragen möchtest, ist die Anmeldung bei den Bing Webmaster Tools der richtige Schritt.

Bing hat zwar einen kleineren Marktanteil als Google, ist aber besonders in bestimmten Branchen und Regionen relevant. Die Registrierung bei Bing Webmaster Tools ist kostenlos und dauert nur wenige Minuten. Zudem unterstützt Bing das IndexNow-Protokoll, das wir später noch genauer betrachten.

Crawler-Tools nutzen (Screaming Frog & Co.)

Neben den Webmaster-Tools der Suchmaschinen gibt es spezialisierte Crawler-Tools wie Screaming Frog, die deine Website aus der Perspektive eines Suchmaschinen-Crawlers analysieren. Diese Tools zeigen dir technische Fehler, fehlende Meta Tags, defekte Links und vieles mehr.

Screaming Frog ist in der Basisversion kostenlos und bietet eine umfassende Analyse deiner Website. Du kannst damit prüfen, ob alle wichtigen Seiten indexierbar sind, ob Canonical Tags korrekt gesetzt sind und ob die interne Verlinkung funktioniert.

| Prüfpunkt | Soll-Zustand |

| Noindex vs. Index | Wichtige Seiten auf „index“, unwichtige auf „noindex“ |

| Canonical Tags | Self-Canonical oder korrekte Canonical-Referenz |

| Interne Verlinkung | Alle wichtigen Seiten intern verlinkt |

| Status Code | Status Code 200 für alle wichtigen Seiten |

CMS-Systeme und automatische Indexierung

Wenn du ein etabliertes Content-Management-System wie WordPress, Shopify, Wix oder Jimdo nutzt, hast du Glück: Diese Systeme generieren automatisch Sitemaps und bieten außerdem Funktionen zur Suchmaschinenoptimierung. Bei WordPress kannst du beispielsweise Plugins wie Yoast SEO oder Rank Math nutzen, um technische SEO-Aspekte zu optimieren.

Shopify erstellt automatisch eine Sitemap und reicht diese bei Google ein, sobald du deinen Shop veröffentlichst. Du musst also keine URL manuell eintragen, das System übernimmt dies für dich. Dennoch solltest du die Google Search Console und Bing Webmaster Tools einrichten, um die Indexierung zu überwachen.

Exkurs: Was ist IndexNow?

IndexNow ist ein Protokoll, das von Microsoft (Bing) und Yandex entwickelt wurde, um Suchmaschinen sofort über neue oder aktualisierte Inhalte zu informieren. Anstatt darauf zu warten, dass Crawler deine Seite erneut besuchen, kannst du über IndexNow eine Benachrichtigung senden. Das beschleunigt die Indexierung erheblich.

Viele CMS-Systeme und SEO-Plugins unterstützen IndexNow bereits. Daher ist es eine effiziente Ergänzung zu den klassischen Methoden. Google unterstützt IndexNow derzeit noch nicht, sondern nutzt eigene Systeme wie die Indexing API.

Praktische Tipps zur Indexierungsprüfung

Neben den umfassenden Tools gibt es auch schnelle, einfache Methoden, um zu prüfen, ob deine Seiten indexiert sind.

Site-Abfrage nutzen

Gib dazu in der Suchmaschine deiner Wahl „site:deine-website.de“ ein. Du siehst dann alle indexierten Seiten deiner Domain in der jeweiligen Suchmaschine. Das ist die schnellste Methode, um einen Überblick zu bekommen und funktioniert sowohl bei Google als auch bei Bing und DuckDuckGo.

URL-Prüfung über die Webmaster Tools von Suchmaschinen

Je nachdem, in welcher Suchmaschine du gefunden werden möchtest, unterscheidet sich das Vorgehen leicht. Um den Indexierungsstatus einzelner Seiten für Google zu überprüfen, kannst du die URL-Prüfung in der Google Search Console nutzen. Du erfährst dort, ob die Seite indexiert ist, wann sie zuletzt gecrawlt wurde und ob Probleme vorliegen.

Für Bing steht ein vergleichbares Tool in den Bing Webmaster Tools zur Verfügung. Auch dort kannst du einzelne URLs prüfen und den Crawling-Status einsehen. DuckDuckGo betreibt keinen eigenen Index, sondern nutzt primär den von Bing. Wer bei Bing gut indexiert ist, ist automatisch auch bei DuckDuckGo sichtbar. Eine separate Prüfung ist daher nicht notwendig.

Regelmäßige Kontrolle etablieren

Richte dir einen monatlichen Termin ein, um die Indexierung in allen für dich relevanten Suchmaschinen zu überprüfen. So erkennst du Probleme frühzeitig und kannst schnell reagieren. Wenn du feststellst, dass wichtige Seiten nicht indexiert sind, prüfe zunächst die robots.txt, Meta Tags und Status Codes. Oft liegt das Problem in einer technischen Blockade, die sich leicht beheben lässt.

Du möchtest deine Website professionell optimieren und bei Google, Bing oder DuckDuckGo sichtbar machen? SELLWERK unterstützt dich mit maßgeschneiderten Lösungen für kleine und mittlere Unternehmen. Tausche dich in der SELLWERK Community mit anderen Unternehmern aus und profitiere von wertvollen Tipps rund um Website-Marketing. Gemeinsam machen wir dein Unternehmen online sichtbar.

Checkliste für einen Suchmaschineneintrag

Damit du den Grundstein für eine erfolgreiche Online-Präsenz legen kannst, haben wir die wichtigsten Schritte noch einmal zusammengefasst:

1. Erstelle eine Sitemap.

2. Konfiguriere die robots.txt korrekt.

3. Setze Meta Tags und Canonical Tags ein.

4. Überwache die Indexierung regelmäßig.

5. Nutze moderne Protokolle wie IndexNow (besonders relevant für Bing).

SELLWERK

Community

Vernetze dich mit gleichgesinnten Unternehmern, tausche Erfahrungen aus und wachse gemeinsam

0 Kommentar

Ähnliche Artikel

Alle Artikel anzeigenWordPress SEO: Anleitung & Top Tipps 2026

Optimiere deine Website für Google mit WordPress-SEO: Ziele, Setup, Keywords, Ladezeit & Plugins. Anleitung mit bewährten SEO-Tipps.

KI-Tools für Unternehmen: Die beliebtesten Tools im Überblick

KI kann bei vielen täglichen Aufgaben unterstützen. Erfahre, welche KI-Tools du für Texte, Analysen, Automatisierung und mehr Produktivität nutzen kannst.

1 LikeGoogle KI-Modus: Das sollten Unternehmen wissen

Der Google KI-Modus verändert die Google-Suche. Erfahre, was das für SEO, Content und die digitale Sichtbarkeit von Unternehmen bedeutet.

Website-Footer: Definition, Beispiele & wichtige Tipps

Die Bedeutung der Website-Fußzeile: mit Tipps, Beispielen & Checklisten für wichtige Links, Impressum, AGB & Copyright. Jetzt informieren!